티스토리 뷰

Paper/SVS

[Paper 리뷰] DiTSinger: Scaling Singing Voice Synthesis with Diffusion Transformer and Implicit Alignment

feVeRin 2026. 3. 9. 10:47반응형

DiTSinger: Scaling Singing Voice Synthesis with Diffusion Transformer and Implicit Alignment

- Singing Voice Synthesis는 data scarcity와 model scalability의 한계가 있음

- DiTSinger

- Fixed melody와 LLM-generated lyrics를 pairing 하여 high-quality singing dataset을 구성

- 추가적으로 RoPE, QK-norm을 기반으로 Diffusion Transformer의 scalability를 확장하고 implicit alignment mechanism을 도입

- 논문 (ICASSP 2026) : Paper Link

1. Introduction

- Singing Voice Synthesis (SVS)는 music score, lyrics로부터 singing voice를 생성함

- 특히 DiffSinger와 같은 diffusion-based model을 활용하면 SVS 성능을 크게 향상할 수 있음

- BUT, SVS는 여전히 다음의 한계점이 존재함:

- Synthesis quality에 대한 scaling effect가 unclear 하고 training data를 expand 하기 어려움

- Robust phoneme-to-acoustic alignment가 필요함

-> 그래서 SVS model의 위 한계점들을 개선한 DiTSinger를 제안

- DiTSinger

- LLM-driven large-scale dataset을 구축하고 Rotary Positional Encoding (RoPE), QK-normalization 기반의 Diffusion Transformer (DiT) architecture를 적용

- 각 phoneme attention을 해당 character span으로 constrain 하는 implicit cross-attention mechanism을 도입

< Overall of DiTSinger >

- DiT 기반의 scalable architecture와 implicit alignment를 활용한 SVS model

- 결과적으로 기존보다 우수한 성능을 달성

2. Method

- Preliminary

- DDPM은 gradual noising process를 reverse 하여 data를 synthesize 함

- 먼저 forward process는 clean sample $\mathbf{x}_{0}$를 다음과 같이 corrupt 함:

(Eq. 1) $ q(\mathbf{x}_{t}|\mathbf{x}_{t-1})=\mathcal{N}(\mathbf{x}_{t};\sqrt{1-\beta_{t}}\mathbf{x}_{t-1}, \beta_{t}I)$

- $\mathcal{N}(\cdot)$ : Gaussian distribution, $\beta_{t}$ : noise schedule - Reverse process는 $c$로 condition 된 neural network $\epsilon_{\theta}(\cdot)$로 modeling 되어 added noise를 predict 함:

(Eq. 2) $\mathcal{L}_{simple}=\mathbb{E}_{\mathbf{x}_{0},\epsilon,t}\left[ \left|\left| \epsilon-\epsilon_{\theta}(\mathbf{x}_{t},t,c)\right|\right|_{2}^{2}\right]$ - Classifier-Free Guidance (CFG)는 fidelity를 향상하기 위해 사용됨:

(Eq. 3) $\epsilon_{guided}=\epsilon_{\theta}(\mathbf{x}_{t})+w\cdot \left(\epsilon_{\theta}(\mathbf{x}_{t},c)-\epsilon_{\theta}(\mathbf{x}_{t})\right)$

- $w$ : guidance strength - Latent Diffusion Model (LDM)은 $\mathbf{x}_{0}$를 latent representation $\mathbf{z}$로 encoding 하여 computational efficiency를 향상함:

(Eq. 4) $\mathbf{z}=\text{Enc}(\mathbf{x}_{0}),\,\,\,\hat{\mathbf{x}}_{0}=\text{Dec}(\mathbf{z})$

- 먼저 forward process는 clean sample $\mathbf{x}_{0}$를 다음과 같이 corrupt 함:

- Data Construction Pipeline

- 기존의 high-quality singing dataset은 scale의 한계가 있으므로 SVS model은 다양한 pitch contour, phonetic variation을 반영하기 어려움

- 이때 training data를 fixed melody의 small set으로 constraining 하고 lyrics, vocal만 varying 하면 melodic alignment와 acoustic modeling의 complexity를 줄일 수 있음

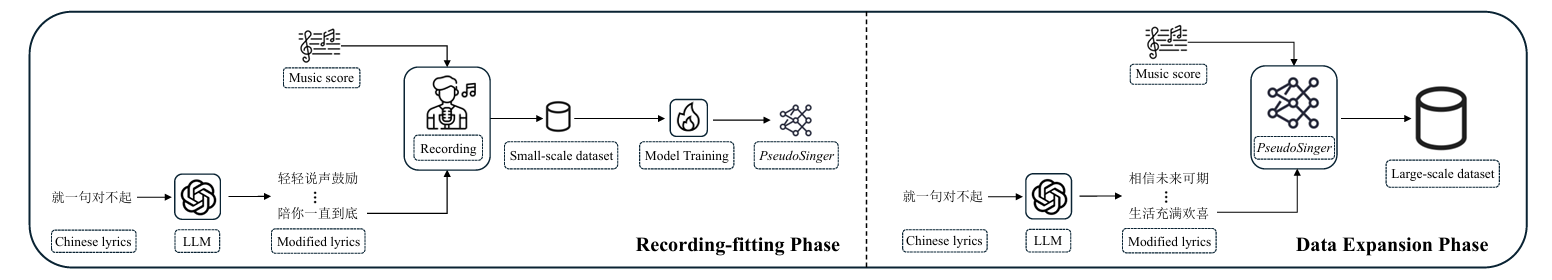

- 이를 통해 SVS model은 underlying melodic structure를 internalize 하여 다양한 lyrical input에 대해서도 robust melody-conditioned synthesis를 보장할 수 있음 - 결과적으로 논문은 Recording-fitting, Data Expansion phase로 구성된 2-stage data construction pipeline을 도입함

- Recording-fitting phase에서는 fixed melody의 small set과 LLM-generated lyrics variant를 pairing 함

- 이후 professional singer가 clean vocal을 record 하여 melody-specific SVS model인 PseudoSinger를 training 하기 위한 compact dataset을 구축함 - Data Expansion phase에서는 각 trained PseudoSinger를 활용하여 large-scale singing data를 생성함

- New lyrics는 LLM을 통해 생성되고, PseudoSinger를 통해 singing voice로 render 됨

- Recording-fitting phase에서는 fixed melody의 small set과 LLM-generated lyrics variant를 pairing 함

- 이때 training data를 fixed melody의 small set으로 constraining 하고 lyrics, vocal만 varying 하면 melodic alignment와 acoustic modeling의 complexity를 줄일 수 있음

- Architecture

- DiTSinger는 Transformer-based latent diffusion model로써, 각 denoising step $t$에서 mel-spectrogram noise $\epsilon$을 predict 함

- Conditioning Inputs

- DiTSinger는 fine-/coarse-grained information을 포함한 hierarchical conditioning input을 사용함

- Fine-grained input (pitch $\mathbf{p}$, phoneme $\mathbf{ph}$, word duration $\mathbf{w}$, slur indicate $\mathbf{sl}$)는 Transformer-based condition encoder $\text{Enc}_{cond}$를 통해 embed, sum, encode 됨:

(Eq. 5) $\mathbf{h}_{local}=\text{Enc}_{cond}\left(\mathbf{E}_{p}(\mathbf{p})+\mathbf{E}_{ph}(\mathbf{ph})+\mathbf{E}_{w}(\mathbf{w})+\mathbf{E}_{sl}(\mathbf{sl}) \right)$

- $\mathbf{E}_{*}(\cdot)$ : learnable embedding - Speaking identity와 같은 coarse-grained input은 MLP를 통해 embed 된 다음, AdaLN을 통해 inject 됨

- Timbre는 reference encoder가 아닌 learnable embedding table로 represent 됨

- Tokenization and Denoising

- Waveform은 mel-spectrogram으로 convert 되고 convolutional downsampler를 통해 latent로 tokenize 됨

- 각 timestep $t$에서는 Gaussian noise가 add 되어 diffusion training을 위한 $\mathbf{x}_{t}$를 얻음 - Denoising network는 $N$ DiTBlock을 stack 하여 구성되고, 각 block은 3개의 parallel branch를 가짐:

- RoPE, QK-Norm을 포함한 Multi-Head Self-Attention (MHSA)

- Fine-grained phoneme condition을 incorporate 한 Masked Multi-Head Cross-Attention (MHCA)

- Point-wise Feed Forward Network

- 여기서 모든 branch는 speaker embedding에 condition 된 AdaLN을 사용하고, residual은 learnable parameter $\alpha_{1},\alpha_{2},\alpha_{3}$로 scaling 됨

- Waveform은 mel-spectrogram으로 convert 되고 convolutional downsampler를 통해 latent로 tokenize 됨

- Implicit Alignment Mechanism

- 논문은 costly phoneme-level duration labeling을 개선하기 위해 implicit alignment mechansim을 도입함

- 먼저 각 phoneme은 known start time $t_{start}$, duration $d_{char}$를 포함한 character의 temporal span을 inherit 하고 tunable offset $\delta$ 만큼 extend backward 됨:

(Eq. 6) $\tilde{t}_{start}=t_{start}-\min(\delta, d_{char},d_{prev}),\,\,\, t_{end}=t_{start}+d_{char}$

- $d_{prev}$ : preceding character의 duration - Resulting interval $[\tilde{t}_{start}, t_{end}]$는 additive attention bias $M\in \mathbb{R}^{L_{mel}\times L_{ph}}$를 construct 하기 위한 valid interval을 정의함:

(Eq. 7) $M_{i,j}=\left\{\begin{matrix}

0, & \text{if}\,\,t_{i}\in[\tilde{t}_{start}^{(j)},t_{end}^{(j)}] \\

-\infty, & \text{otherwise} \\

\end{matrix}\right.$ - $Q\in\mathbb{R}^{L_{mel}\times d}$를 mel token에서 project 된 query, $K,V\in\mathbb{R}^{L_{ph}\times d}$를 fused local condition representation $\mathbf{h}_{local}$에서 project된 key, value라고 하자

- 그러면 masked cross-attention은:

(Eq. 8) $\text{Attention}(Q,K,V)=\text{softmax}\left(\frac{QK^{\top}}{\sqrt{d}}+M\right)V$ - 해당 fixed mask는 training/inference 모두에서 consistently apply 됨

- Training 시에는 model이 coarse-timing constraint 하에서 soft, localized alignment를 학습하도록 guide 하고 추론 시에는 temporal constraint를 통해 stable, consistent attention pattern을 보장함

- 그러면 masked cross-attention은:

3. Experiments

- Settings

- Dataset : M4Singer

- Comparisons : DiffSinger, StyleSinger, TCSinger

- Results

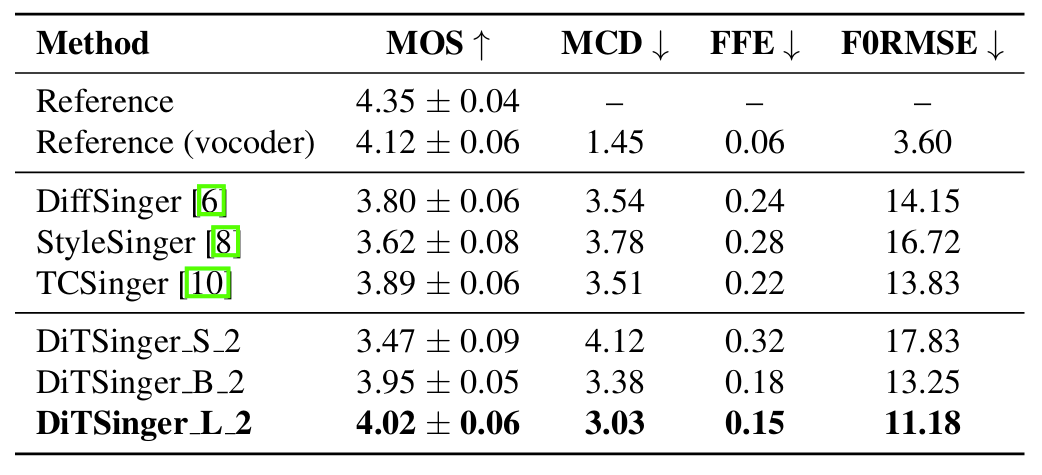

- 전체적으로 DiTSinger의 성능이 가장 우수함

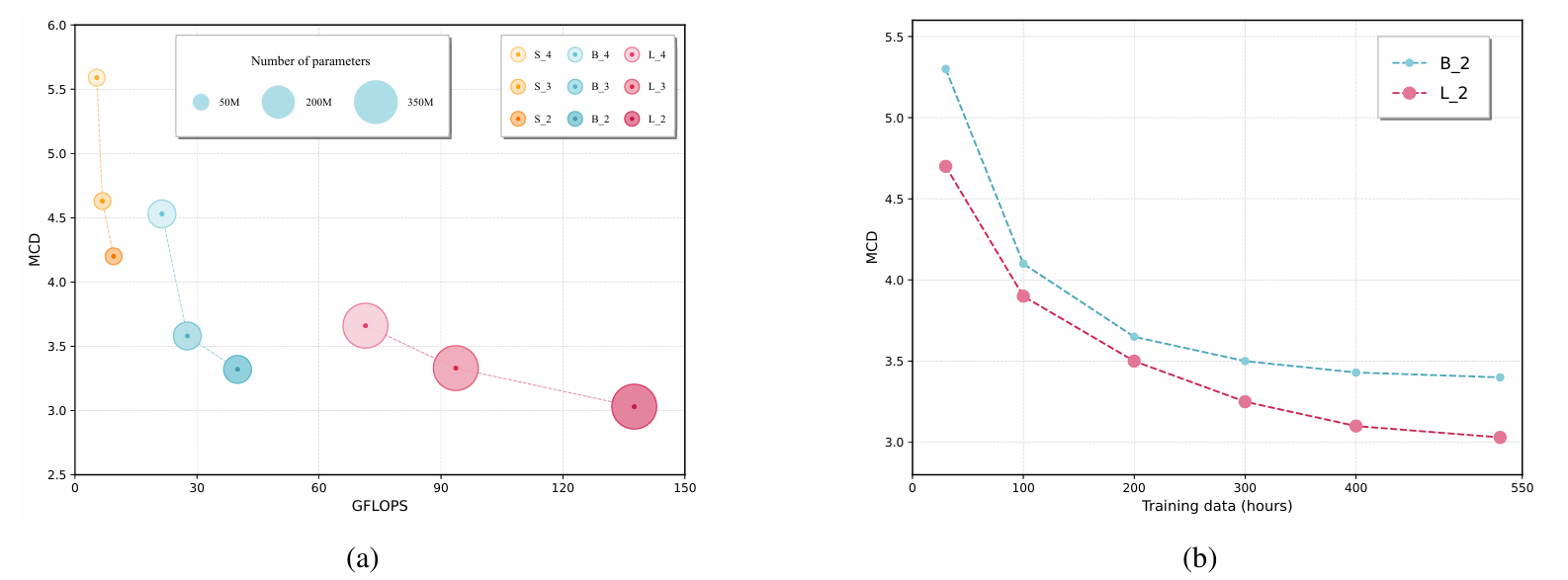

- DiTSinger는 model size, dataset scale 측면에서 strong scalability를 보임

- Effectiveness of PseudoSinger

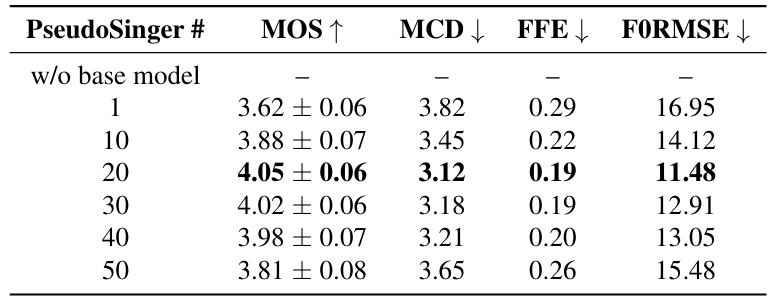

- 20 group의 PseudoSinger를 사용할 때 최적의 성능을 달성함

반응형

'Paper > SVS' 카테고리의 다른 글

댓글