티스토리 뷰

Paper/Vocoder

[Paper 리뷰] UnivNet: A Neural Vocoder with Multi-Resolution Spectrogram Discriminators for High-Fidelity Waveform Generation

feVeRin 2024. 3. 22. 10:12반응형

UnivNet: A Neural Vocoder with Multi-Resolution Spectrogram Discriminators for High-Fidelity Waveform Generation

- Full-band spectral feature를 사용하면 vocoder에 많은 acoustic information을 제공할 수 있음

- BUT, full-band mel-spectrogram 사용 시 over-smoothing 문제가 발생할 수 있음 - UnivNet

- Full-band over-smoothing 문제를 해결하는 고품질 neural vocoder

- Multiple linear spectrogram magnitude를 사용하는 multi-resolution spectrogram discriminator를 도입

- 논문 (INTERSPEECH 2021) : Paper Link

1. Introduction

- Generative Adversarial Network (GAN)을 neural vocoder에 적용하면 빠르고, high-fidelity의 음성을 얻을 수 있음

- 일반적으로 neural vocoder는 mel-spectrogram을 사용하여 waveform을 생성함

- 이때 high-frequency band의 acoustic information이 모델에 제공되지 않음 - 한편으로 sampling rate의 절반에 해당하는 spectral feature를 input으로 사용하여 full-band acoustic information을 제공할 수 있음

- BUT, full-band mel-spectrogram을 사용하면 non-sharp spectrogram으로 인해 over-smoothing이 발생함 - 이때 GAN의 discriminator를 통해 해당 문제를 해결할 수 있음

- Discriminator가 temporal feature 뿐만 아니라 multiple resolution spectral feature를 input으로 사용하도록 하면 binary classification 성능을 향상할 수 있음

- 일반적으로 neural vocoder는 mel-spectrogram을 사용하여 waveform을 생성함

-> 그래서 full-band oversmoothing 문제를 해결하기 위해 multi-resolution spectrogram discriminator를 사용하는 UnivNet을 제안

- UnivNet

- 다양한 parameter set을 사용하여 계산된 multiple linear spectrogram magnitude를 사용하는 Multi-Resolution Spectrogram Discriminator (MRSD)를 도입

- Full-band mel-spectrogram을 input으로 사용하여 MRSD를 통해 high-resolution signal을 생성

- 추가적으로 waveform의 여러 scale에 대한 Multi-Period Waveform Discriminator (MPWD)와 결합하여 spectral, temporal domain 모두를 모델링하도록 함

< Overall of UnivNet >

- Full-band over-smoothing 문제를 해결하는 고품질, real-time neural vocoder

- Multiple linear spectrogram magnitude를 사용하는 MRSD를 도입

- 결과적으로 기존 GAN-based vocoder 보다 우수한 합성 품질과 추론 속도를 달성

2. Method

- Generator

- UnivNet generator $G$는 MelGAN의 아이디어를 활용함

- Noise sequence $z$는 input으로 사용되고 log mel-spectrogram $c$는 condition으로 사용됨

- $z$의 length는 $c$와 동일하고, output $\hat{x}$의 length는 transposed convolution을 통해 target waveform $x$와 동일해짐 - Condition의 local information을 효율적으로 capture하기 위해, Location-Variable Convolution (LVC)를 추가함

- LVC layer의 kernel은 log mel-spectrogram을 input으로 사용하는 kernel predictor를 통해 예측됨

- Kernel predictor는 residual stack에 연결되고, 하나의 kernel predictor는 하나의 residual stack에 있는 모든 LVC layer의 kernel을 동시에 예측함 - Multi-speaker에서의 generality를 향상하기 위해, Gated Activation Unit (GAU)가 각 residual connection에 추가됨

- Noise sequence $z$는 input으로 사용되고 log mel-spectrogram $c$는 condition으로 사용됨

- Discriminator

- Discriminator $D$는 real/generated signal에서 계산된 multiple spectrogram과 reshaped waveform을 활용함

- 이를 위한 Multi-Resolution Spectrogram Discriminator (MRSD)는

- 각 $m$-th sub-discriminator에 대한 input을 위해, $M$개의 real/generated linear spectrogram magnitude $\{s_{m}=|FT_{m}(x)|,\hat{s}_{m}=|FT_{m}(\hat{x})|\}_{m=1}^{M}$는,

- $M$ STFT parameter set $\{FT_{m}(\cdot)\}^{M}_{m=1}$을 사용하여 동일한 waveform에서 계산됨

- 각각은 Fourier transform의 point 수, frame shift interval, window length를 포함 - MRSD는 다양한 temporal, spectral resolution을 가지는 multiple spectrogram을 사용하므로, full-band에 걸쳐 high-resolution signal을 생성할 수 있음

- 각 $m$-th sub-discriminator에 대한 input을 위해, $M$개의 real/generated linear spectrogram magnitude $\{s_{m}=|FT_{m}(x)|,\hat{s}_{m}=|FT_{m}(\hat{x})|\}_{m=1}^{M}$는,

- 구조적으로는 MelGAN의 Multi-Scale Wavefrom Discriminator (MSWD)를 기반으로 strided 2D convolution과 Leaky ReLU로 구성됨

- Temporal doamin에서 detailed adversarial 모델링을 위해 HiFi-GAN의 Multi-Period Waveform Discriminator (MPWD)를 추가함

- 이때 waveform의 periodic component는 prime number set의 interval로 추출되어 각 sub-discriminator에 대한 input으로 사용됨

- 이를 위한 Multi-Resolution Spectrogram Discriminator (MRSD)는

- Training Loss

- Multi-resolution STFT loss는 학습을 위한 auxiliary loss로써, 다양한 STFT parameter set을 사용하여 계산된 multiple spectrogram loss의 합에 해당함

- Spectral convergence loss $\mathcal{L}_{sc}$와 log STFT magnitude loss $\mathcal{L}_{mag}$로 구성된 loss $\mathcal{L}_{aux}$는:

(Eq. 1) $\mathcal{L}_{sc}(s,\hat{s})=\frac{||s-\hat{s}||_{F}}{||s||_{F}}, \,\, \mathcal{L}_{mag}(s,\hat{s})=\frac{1}{S}|| \log s-\log \hat{s}||_{1}$

(Eq. 2) $\mathcal{L}_{aux}(x,\hat{x})=\frac{1}{M}\sum_{m=1}^{M}\mathbb{E}_{x,\hat{x}}\left[ \mathcal{L}_{sc}(s_{m},\hat{s}_{m})+\mathcal{L}_{mag}(s_{m},\hat{s}_{m})\right]$

- $|| \cdot ||_{F}, || \cdot ||_{1}$ : 각각 Frobenius, $L1$ norm, $S$ : spectrogram의 element 수

- $m$-th $\mathcal{L}_{sc}, \mathcal{L}_{mag}$는 $m$-th MRSD sub-discriminator에 사용된 $s_{m}$과 $\hat{s}_{m}$을 reuse 함

- 각 loss의 개수는 $M$으로, MRSD sub-discriminator의 개수와 동일 - UnivNet은 least squares GAN의 objective를 사용하고, 이때 overall objective는:

(Eq. 3) $\mathcal{L}_{G}=\lambda \mathcal{L}_{aux}(x,G(z,c))+\frac{1}{K}\sum_{k=1}^{K}\mathbb{E}_{z,c}[(D_{k}(G(z,c))-1)^{2}]$

(Eq. 4) $\mathcal{L}_{D}=\frac{1}{K}\sum_{k=1}^{K}(\mathbb{E}_{x}[(D_{k}(x)-1)^{2}]+\mathbb{E}_{z,c}[D_{k}(G(z,c))^{2}])$

- $D_{k}$ : MRSD, MPWD의 $k$-th sub-discriminator, $K$ : 전체 sub-discriminator 수, $\lambda$ : balance parameter

- Spectral convergence loss $\mathcal{L}_{sc}$와 log STFT magnitude loss $\mathcal{L}_{mag}$로 구성된 loss $\mathcal{L}_{aux}$는:

3. Experiments

- Settings

- Results

- Ablation Study

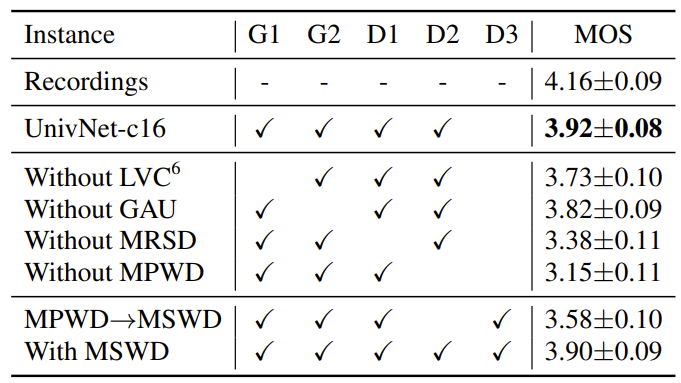

- 아래 표에서 G1= LVC, G2=GAU, D1=MRSD, D2=MPWD, D3=MSWD

- 각 component들은 모두 UnivNet의 성능 향상에 크게 기여함

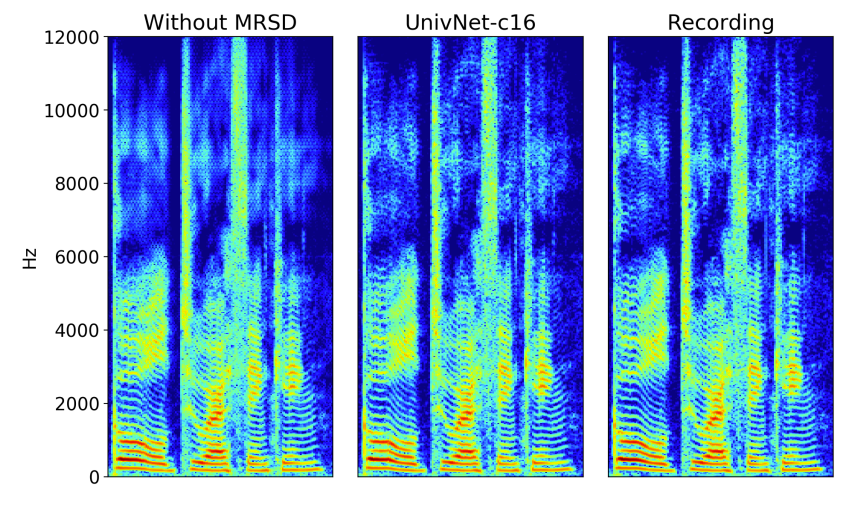

- 특히 MRSD를 제거하는 경우, high-frequency band에서 over-smoothing 문제가 발생함

- 결과적으로 MOS 저하로 이어짐

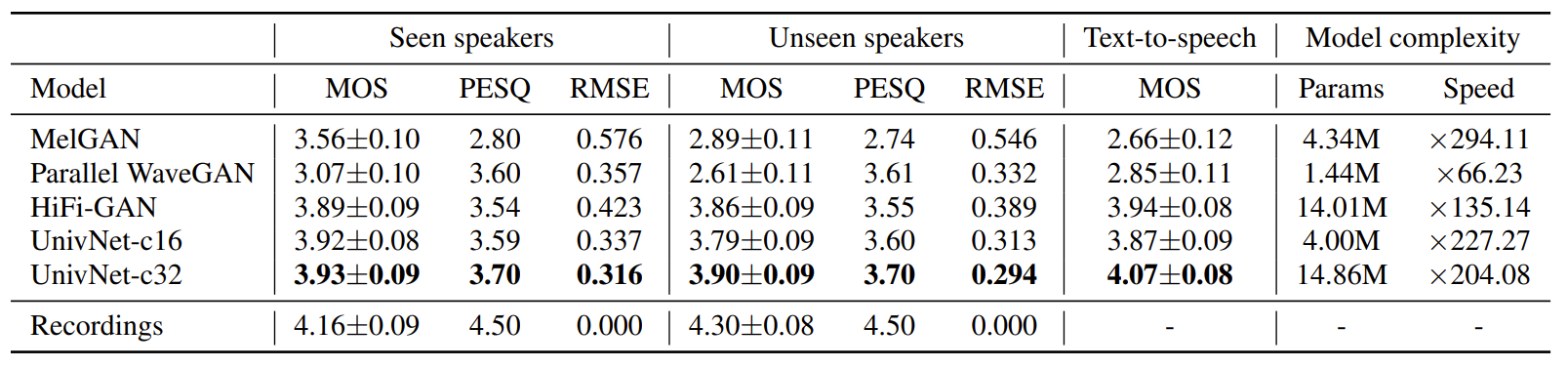

- Comparison with Existing Models

- 전체적인 합성 품질 측면에서도 UnivNet이 가장 우수한 것으로 나타남

- 합성 효율성 측면에서 UnivNet은 더 적은 수의 parameter로 real-time보다 200배 빠른 합성 속도를 보임

반응형

'Paper > Vocoder' 카테고리의 다른 글

댓글