[Paper 리뷰] AutoNF: Automated Architecture Optimization of Normalizing Flows with Unconstrained Continuous Relaxtion Admmitting Optimal Discrete Solution

[Paper 리뷰] AutoNF: Automated Architecture Optimization of Normalizing Flows with Unconstrained Continuous Relaxtion Admmitting Optimal Discrete Solution

AutoNF: Automated Architecture Optimization of Normalizing Flows with Unconstrained Continuous Relaxtion Admitting Optimal Discrete Solution강력하면서도 계산 효율적인 flow model을 구축하는 것은 여전히 어려움이를 위해 Neural Architecture Search를 고려할 수 있지만, Normalizing Flow의 invertibility constraint로 인해 기존 방식들은 적용하기 어려움AutoNFNormalizing Flow에 대한 automated architectural optimization frameworkFlow model의 invertibility constrain..

[Paper 리뷰] PortaSpeech: Portable and High-Quality Generative Text-to-Speech

[Paper 리뷰] PortaSpeech: Portable and High-Quality Generative Text-to-Speech

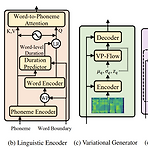

PortaSpeech: Portable and High-Quality Generative Text-to-SpeechNon-autoregressive Text-to-Speech 모델은 고품질의 음성 합성이 가능하지만 몇 가지 한계가 있음- VAE는 작은 모델 size로도 long-range semantic feature를 capture 할 수 있지만, 종종 부자연스러운 결과를 생성함- Normalizing Flow는 frequency bin-wise detail을 reconstruct 하는데 좋지만, 많은 parameter 수를 필요로 함PortaSpeechLightweight architecture를 사용하여 고품질의 음성 합성을 지원하는 TTS 모델Enhanced prior를 포함한 lightweigh..

[Paper 리뷰] VarianceFlow: High-Quality and Controllable Text-to-Speech using Variance Information via Normalizing Flow

[Paper 리뷰] VarianceFlow: High-Quality and Controllable Text-to-Speech using Variance Information via Normalizing Flow

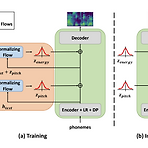

VarianceFlow: High-Quality and Controllable Text-to-Speech using Variance Information via Normalizing Flow Text와 speech 간의 one-to-many 관계를 학습하기 위해 두 가지 방식을 활용할 수 있음 - Normalizing Flow의 사용 - 합성 과정에서 pitch, energy 같은 variance information의 반영 VarianceFlow Normalizing Flow를 통해 variance를 모델링하여 더 정확하게 variance information을 예측 Normalizing Flow의 objective function은 variance와 text를 disentangle 하여 varianc..

[Paper 리뷰] CyFi-TTS: Cyclic Normalizing Flow with Fine-Grained Representation for End-to-End Text-to-Speech

[Paper 리뷰] CyFi-TTS: Cyclic Normalizing Flow with Fine-Grained Representation for End-to-End Text-to-Speech

CyFi-TTS: Cyclic Normalizing Flow with Fine-Grained Representation for End-to-End Text-to-Speech End-to-End Text-to-Speech는 unseen data에 대해 적용하는 것은 어려움 One-to-many 문제로 인해 text와 음성 사이에 information gap이 발생하여 mispronunciation 되기 쉽기 때문 CyFi-TTS Cyclic normalizing flow를 도입하여 information gap을 해소해 자연스러운 음성을 합성 Temporal multi-resolution upsampler를 도입하여 fine-grained representation을 점진적으로 생성 논문 (ICASSP 20..